Investigación revela riesgos críticos en proveedores de IA

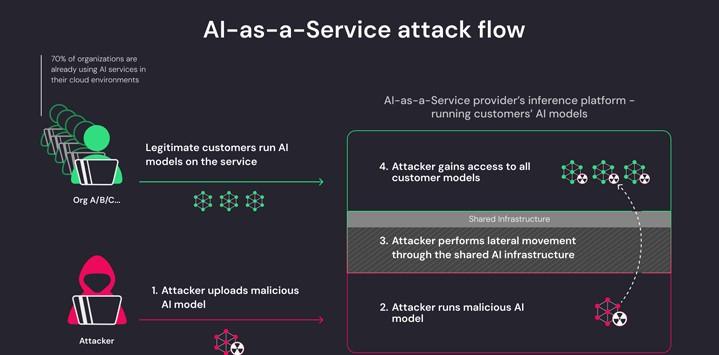

Nuevas investigaciones han encontrado que los proveedores de inteligencia artificial (IA) como servicio, como Hugging Face, son susceptibles a dos riesgos críticos que podrían permitir a actores de amenazas escalar privilegios, obtener acceso cruzado a los modelos de otros clientes e incluso tomar el control de los pipelines de integración y despliegue continuo (CI/CD) de las aplicaciones.

Impacto y peligro potencial

“Los modelos maliciosos representan un riesgo importante para los sistemas de IA, especialmente para los proveedores de IA como servicio porque los posibles atacantes pueden aprovechar estos modelos para realizar ataques entre inquilinos,” explicaron los investigadores. Este peligro podría tener un impacto devastador al permitir a los atacantes acceder a millones de modelos de IA privados almacenados en estos servicios.

Vectores de ataque emergentes

Estos hallazgos llegan en un momento en que los pipelines de aprendizaje automático se han convertido en un nuevo vector de ataque de la cadena de suministro. Repositorios como Hugging Face se han vuelto atractivos para ataques adversariales diseñados para obtener información sensible y acceder a entornos objetivo.

Amenazas identificadas

La investigación identifica dos riesgos principales: la toma de control de la infraestructura de inferencia compartida y la toma de control compartida de CI/CD. Estos riesgos permiten ejecutar modelos no confiables cargados en el servicio y tomar el control de los pipelines de CI/CD para realizar ataques de cadena de suministro.

Medidas de mitigación y soluciones

Para abordar estos problemas, se recomienda implementar IMDSv2 con límite de salto para evitar que los pods accedan a servicios sensibles y habilitar la autenticación multifactor. Además, Hugging Face ha abordado todas las vulnerabilidades identificadas y alienta a los usuarios a utilizar modelos solo de fuentes confiables y a abstenerse de usar archivos pickle en entornos de producción.

Conclusiones y advertencias

La investigación subraya la importancia de ejercer precaución al utilizar modelos de IA no confiables, especialmente en entornos compartidos. Asimismo, destaca la necesidad de ejecutar estos modelos en entornos aislados para evitar consecuencias de seguridad graves.