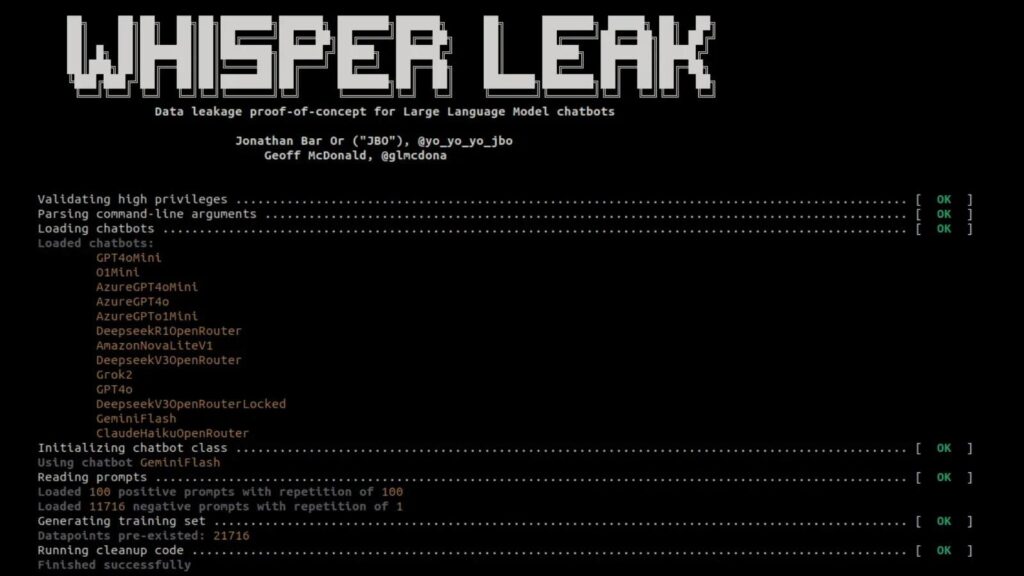

Investigadores ha revelado un nuevo tipo de ataque de canal lateral denominado Whisper Leak, que permite a un adversario pasivo (que monitoriza el tráfico de red) inferir el tema que un usuario está discutiendo con un chatbot de Inteligencia Artificial (IA), incluso cuando la comunicación está cifrada con TLS.

Whisper Leak: Inferencia de Temas por Metadatos Cifrados

El ataque explota el comportamiento del streaming de respuestas en los Modelos de Lenguaje Grandes (LLM), donde el patrón de tamaños de paquetes y los tiempos entre ellos filtran metadatos sensibles.

Mecanismo Técnico

- Monitoreo Pasivo: Los investigadores monitorearon el tráfico cifrado entre el usuario y un modelo de IA en modo streaming (flujo de respuesta continuo).

- Análisis de Patrones: Se analizaron metadatos como el tamaño de los paquetes y los intervalos de llegada (el ritmo con que se generan los tokens).

- Clasificador Entrenado: Mediante el entrenamiento de clasificadores avanzados (LightGBM, Bi-LSTM, BERT), los investigadores lograron distinguir conversaciones sobre un tema específico (ej., “legislación de lavado de dinero”) con una precisión de más del 98% en algunos modelos.

Por Qué es Preocupante

- Violación de Privacidad: El metadato (“el usuario está hablando de X tema”) es suficiente para la vigilancia, el espionaje o la discriminación. Esto es especialmente grave dado el uso de LLMs en sanidad, finanzas, asesoría legal y gobierno.

- Cifrado Insuficiente: Muchos equipos de seguridad se centran en el cifrado del contenido, pero descuidan la “meta-capa” que Whisper Leak explota. La encriptación por sí sola no garantiza la privacidad completa.

- Vulnerabilidad del Streaming: Los modelos que utilizan streaming de tokens (generación continua de respuesta) parecen ser los más vulnerables, ya que dejan huellas de tiempo y tamaño más reconocibles.

- Alta Precisión: Una tasa de detección de $approx 98%$ significa que un adversario bien posicionado (ISP, red compartida) puede etiquetar conversaciones sobre temas sensibles (terrorismo, fraude, disidencia) con muy pocos falsos positivos.

Recomendaciones

- Para Proveedores de Servicios de IA / Plataformas

- Añadir Ruido (Padding): Implementar padding aleatorio de respuesta o latencia artificial para que el patrón de tamaño/tiempo quede oculto. (Microsoft ya ha implementado mitigaciones en algunos casos).

- Batching de Respuestas: Usar batching de tokens o agrupar respuestas en vez de streaming token-por-token, lo cual reduce la visibilidad del ritmo de generación.

- Auditoría Adversarial: Auditar y testear modelos de lenguaje con AI adversarial hunting para verificar si los temas pueden inferirse solo con metadatos.

- Para Usuarios y Organizaciones

- Protección de Tráfico: Si se usa un chatbot de IA en una red no confiable (Wi-Fi pública, ISP sospechoso), evitar temas extremadamente sensibles.

- Uso de VPNs: Considerar usar una VPN o túneles cifrados que, además de cifrar contenido, cambien el ritmo o tamaño de los paquetes para entorpecer el análisis.

- Modelos Locales: Para entornos de alta seguridad (consultas legales, defensa), considerar usar modelos offline/locales que no expongan el tráfico a un observador externo.

- Selección de Proveedor: Elegir proveedores de chat de IA que hayan declarado que implementan mitigaciones frente a Whisper Leak o similares.