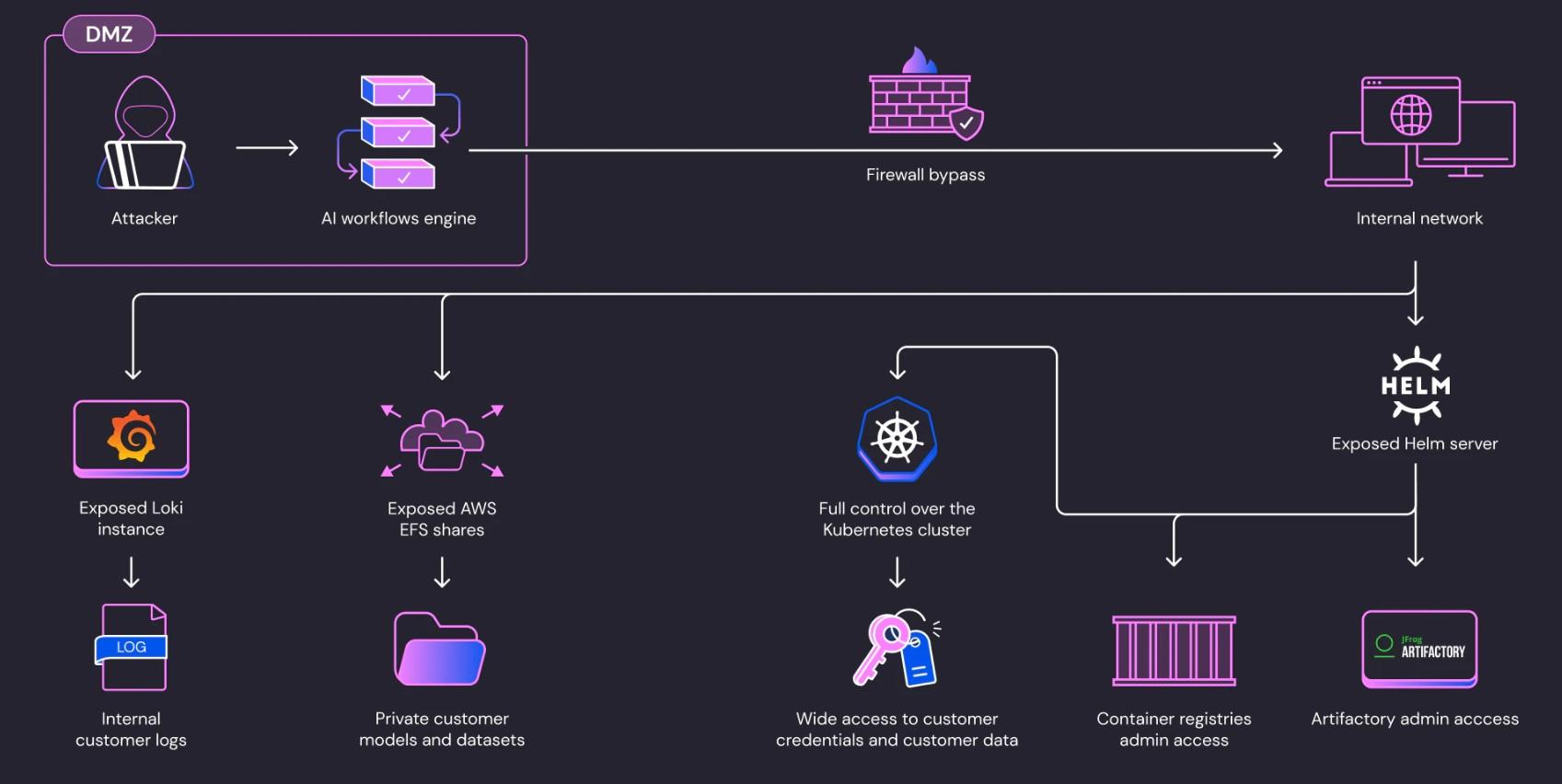

En un reciente estudio, Wiz Research ha identificado vulnerabilidades críticas en SAP AI Core, una plataforma de inteligencia artificial gestionada por SAP. Estas brechas de seguridad podrían permitir a atacantes tomar control del servicio y acceder a datos sensibles de los clientes, incluyendo credenciales de entornos cloud y artefactos de IA privados.

Introducción a la Investigación

La investigación de Wiz Research comenzó con el uso legítimo de los procedimientos de entrenamiento de IA en la infraestructura de SAP. A través de la ejecución de código arbitrario, los investigadores lograron moverse lateralmente dentro del sistema y obtener acceso a archivos privados y credenciales de los entornos cloud de los clientes, como AWS, Azure y SAP HANA Cloud.

Detalle de las Vulnerabilidades

- Bypass de Restricciones de Red

Los investigadores descubrieron que podían configurar el entorno del Pod para compartir el namespace del proceso con el contenedor sidecar de Istio, accediendo así a la configuración de Istio y sus tokens de acceso. Configurando su UID como 1337, lograron eludir las restricciones de tráfico impuestas por Istio.

- Filtración de Tokens AWS desde Loki

Encontraron una instancia de Grafana Loki que respondía a solicitudes de configuración con secretos de AWS, permitiendo acceso a un bucket S3 con registros de los servicios de AI Core y Pods de clientes.

- Comparticiones EFS sin Autenticación

Seis instancias de AWS Elastic File System (EFS) estaban expuestas sin autenticación, permitiendo el acceso a datos de entrenamiento y código categorizados por ID de cliente.

- Servidor Helm sin Autenticación

Un servidor Tiller de Helm expuesto permitió a los investigadores acceder a registros de Docker y Artifactory internos de SAP, con capacidad para leer y modificar imágenes de contenedores y artefactos, facilitando potenciales ataques a la cadena de suministro.

- Compromiso del Clúster K8s

El servidor Helm también permitió una toma de control completa del clúster Kubernetes, otorgando privilegios de administrador del clúster. Esto expuso datos sensibles de los Pods de otros clientes y permitió la manipulación de modelos de IA y datos de entrenamiento.

Conclusiones y Lecciones Aprendidas

La investigación de Wiz Research destaca la necesidad de reforzar las medidas de seguridad en los servicios de IA gestionados, especialmente en lo que respecta a la separación de inquilinos y la protección de la red interna. El entrenamiento de modelos de IA implica la ejecución de código arbitrario, lo que requiere guardrails apropiados para asegurar que el código no confiable esté adecuadamente aislado de los activos internos y otros inquilinos.

Cronología de la Divulgación

- 25 de enero de 2024: Wiz Research informa los hallazgos a SAP.

- 27 de enero de 2024: SAP responde y asigna un número de caso.

- 16 de febrero de 2024: SAP corrige la primera vulnerabilidad y rota los secretos relevantes.

- 28 de febrero de 2024: Wiz Research elude el parche usando dos nuevas vulnerabilidades y las informa a SAP.

- 15 de mayo de 2024: SAP despliega soluciones para todas las vulnerabilidades reportadas.

- 17 de julio de 2024: Divulgación pública.

Esta investigación subraya la importancia de la defensa en profundidad y la necesidad de estándares más rigurosos en la industria para la ejecución segura de modelos de IA.